Термин "информация" происходит от латинского слова "informatio", что означает сведения, разъяснения, изложение. Несмотря на широкое распространение этого термина, понятие информации является одним из самых дискуссионных в науке.

В "Большом энциклопедическом словаре" информация определяется как "общенаучное понятие, включающее обмен сведениями между людьми, человеком и автоматом, автоматом и автоматом обмен сигналами в животном и растительном мире; передачу признаков от клетки к клетке, от организма к организму (генетическая информация). В настоящее время наука пытается найти общие свойства и закономерности, присущие многогранному понятию информация , но пока это понятие во многом остается интуитивным и получает различные смысловые наполнения в различных отраслях человеческой деятельности:

· в обиходе информацией называют любые данные или сведения, которые кого-либо интересуют. Например, сообщение о каких-либо событиях, о чьей-либо деятельности и т.п. "Информировать" в этом смысле означает "сообщить нечто , неизвестное раньше" ;

· в технике под информацией понимают сообщения, передаваемые в форме знаков или сигналов;

· в кибернетике под информацией понимает ту часть знаний, которая используется для ориентирования, активного действия, управления, т.е. в целях сохранения, совершенствования, развития системы (Н. Винер).

Понятие данные более общее чем информатика, в нем смысловые свойства сообщения как бы отступают на второй план. Когда нет необходимости подчеркнуть разницу между понятиями данные (вся совокупность сведений) и информация (новые полезные сведения) эти слова используют как синонимы .

В соответствии с этим для оценки количества информации используются разные единицы.

При передаче информации важно обратить внимание на то, какое количество информации пройдет через передающую систему. Ведь информацию можно измерить количественно, подсчитать. И поступают при подобных вычислениях самым обычным путем: абстрагируются от смысла сообщения, как отрешаются от конкретности в привычных всем нам арифметических действиях (как от сложения двух яблок и трех яблок переходят к сложению чисел вообще: 2+3).

1.2.2 Свойства информации

К важнейшим свойствам информации относятся:

- полнота;

- ценность;

- своевременность (актуальность);

- понятность;

- доступность;

- краткость;

- и др.

Адекватность информации может выражаться в трех формах: семантической, синтаксичес-кой, прагматической.

Если ценная и своевременная информация выражена непонятным образом, она может стать бесполезной.

Информация становится понятной , если она выражена языком, на котором говорят те, кому предназначена эта информация.

Информация должна преподноситься в доступной (по уровню восприятия) форме. Поэтому одни и те же вопросы по-разному излагаются в школьных учебниках и научных изданиях.

Информацию по одному и тому же вопросу можно изложить кратко (сжато, без несущественных деталей) или пространно (подробно, многословно). Краткость информации необходима в справочниках, энциклопедиях, учебниках, всевозможных инструкциях.

1.2.1. Информатизация и компьютеризация общества. Информационные ресурсы.

Информационные процессы (сбор, обработка и передача информации) всегда играли важную роль в жизни общества. В ходе эволюции человечества просматривается устойчивая тенденция к автоматизации этих процессов.

Средства обработки информации — это всевозможные устройства и системы, созданные человечеством, и в первую очередь, компьютер — универсальная машина для обработки информации.

Компьютеры обрабатывают информацию путем выполнения некоторых алгоритмов.

Живые организмы и растения обрабатывают информацию с помощью своих органов и систем.

Человечество занималось обработкой информации тысячи лет. Существует мнение, что мир пережил несколько информационных революций.

Первая информационная революция связана с изобретением и освоением человеческого языка, который, точнее устная речь, выделила человека из мира животных. Это позволило человеку хранить, передавать, совершенствовать, увеличивать приобретенную информацию.

Вторая информационная революция заключалась в изобретении письменности. Прежде всего, резко возросли (по сравнению с предыдущим этапом) возможности по хранению информации. Человек получил искусственную внешнюю память. Организация почтовых служб позволила использовать письменность и как средство для передачи информации. Кроме того, возникновение письменности было необходимым условием для начала развития наук (вспомним Древнюю Грецию , например). С этим же этапом, по всей видимости, связано и возникновение понятия натуральное число . Все народы, обладавшие письменностью, владели понятием числа и пользовались той или иной системой счисления.

Все-таки, зафиксированное в письменных текстах знание было ограниченным, и, следовательно, мало доступным. Так было до изобретения книгопечатания .

Что обосновало третью информационную революцию. Здесь наиболее очевидна связь информации и технологии. Книгопечатание можно смело назвать первой информационной технологией. Воспроизведение информации было поставлено на поток, на промышленную основу. По сравнению с предыдущим этот этап не столько увеличил возможности по хранению (хотя и здесь был выигрыш: письменный источник - часто один-единственный экземпляр, печатная книга - целый тираж экземпляров, а следовательно, и малая вероятность потери информации при хранении (вспомним "Слово о полку Игореве ")), сколько повысил доступность информации и точность ее воспроизведения. Механизмом этой революции был печатный станок, который удешевил книгу и сделал информацию более доступной.

Четвертая революция, плавно переходящая в пятую , связана с созданием современных информационных технологий. Этот этап связан с успехами точных наук (прежде всего математики и физики) и характеризуется возникновением таких мощных средств связи, как телеграф (1794г. - первый оптический телеграф , 1841г. - первый электромагнитный телеграф), телефон (1876г.) и радио (1895г.), к которым по завершению этапа добавилось и телевидение (1921г.). Кроме средств связи появились новые возможности по получению и хранению информации - фотография и кино. К ним также очень важно добавить разработку методов записи информации на магнитные носители (магнитные ленты, диски). Но самым поразительным было создание современных компьютеров и средств телекоммуникаций.

В настоящее время термин "информационная технология" употребляется в связи с использованием компьютеров для обработки информации. Информационные технологии охватывают всю вычислительную технику и технику связи и, отчасти, — бытовую электронику, телевидение и радиовещание.

Они находят применение в промышленности, торговле, управлении, банковской системе , образовании, здравоохранении, медицине и науке, транспорте и связи, сельском хозяйстве, системе социального обеспечения, служат подспорьем людям различных профессий и домохозяйкам.

Народы развитых стран осознают, что совершенствование информационных технологий представляет самую важную, хотя дорогостоящую и трудную задачу.

В настоящее время создание крупномасштабных информационно-технологических систем является экономически возможным, и это обусловливает появление национальных исследовательских и образовательных программ, призванных стимулировать их разработку.

После решения задачи обработки информации результат должен быть выдан конечным пользователям в требуемом виде. Эта операция реализуется в ходе решения задачи выдачи информации. Выдача информации , как правило, производится с помощью внешних устройств вычислительной техники в виде текстов, таблиц, графиков и т.д.

Стержнем любой информационной технологии является выбор и реализация наиболее рационального информационного процесса, который можно определить как совокупность процедур по преобразованию и обработке информации.

В свою очередь информационной процедурой принято считать совокупность однородных операций, воздействующих определенным образом на информацию. Основными информационными процедурами являются: регистрация, сбор, передача, кодирование, хранение и обработка информации.

Реализация любой задачи конкретного пользователя требует создания системы информационного обслуживания, которую чаще называют информационной системой.

Пусть А={а1, а2, …, аn} - алфавит некоторого языка. А* - множество всевозможных последовательностей символов этого языка.

Язык - это подмножество А*, которое удовлетворяет двум системам правил: синтаксическим (голубая штриховка) и семантическим (штриховка бордо), причем семантическим правилам могут удовлетворять только те конструкции, которые удовлетворяют синтаксическим правилам.

Пример: ббсе - не удовлетворяет синтаксису русского языка

Петя съел трактор - все синтаксические правила соблюдены, но предложение не удовлетворяет семантике русского языка

Таким образом, знание языка означает

1. Знание его алфавита,

2. Знание синтаксических правил

3. Знание семантических правил

В этом случае вы сможете общаться и будете правильно поняты.

Преобразование конструкций одного языка в последовательность букв другого алфавита называется кодированием.

Если говорить о кодировании, то сначала надо определить, какую конструкцию языка будем рассматривать в качестве символа, т.е. некоторой неделимой конструкции.

Рассмотрим некоторое предложение языка Q. Предложение состоит из слов, которые в свою очередь состоят из букв. Возможны 3 варианта определения символа (неделимой конструкции языка):

1. символ = буква: предложение - последовательность букв алфавита. Такой подход используется при письменной записи.

2. символ = слово. Такое представление предложений используется в стенографии.

3. символ = предложение. Такая ситуация возникает при переводе с одного языка на другой, причем особенно ярко это проявляется при переводе пословиц, шуток, поговорок.

Проблемой кодирования начал заниматься великий немецкий математик Готфрид Вильгельм Лейбниц ; он доказал, что минимальное количество букв, необходимое для кодирования любого алфавита, равно 2.

Пример. Русский язык: 33 буквы*2 (прописные, строчные)-2(ъ,ь) + 10 знаков препинания +10 цифр = 84 символа. Обязательным условием правильного кодирования является возможность однозначного преобразования АÛВ. Сколько двоичных символов необходимо, чтобы закодировать один символ русского языка?

| буква | код |

| а | |

| А | |

| б | |

| Б | |

| в | |

| В | |

| … | |

| м | |

| М |

Предположим, надо закодировать слово Мама. Закодируем его: 10011 0 10010 0. Сделайте обратное преобразование (декодирование). Возникают проблемы, т.к. не понятно, где заканчивается одна буква и начинается другая. Основное правило однозначного преобразования из А в В и обратно нарушено, причина - использование кода переменной длины, следовательно необходимо выбрать код одинаковой заранее определенной длины. Какой?

Вывод: чем меньше букв в алфавите, тем длиннее символ. В русском языке 33 буквы, слова в среднем состоят из 4-6 букв. В японском языке около 3000 иероглифов, в среднем 1 предложение ~ 1 иероглиф.

В вычислительных машинах используется двоичное кодирование информации любого типа: программы, текстовые документы, графические изображения , видеоклипы, звуки и т.д. Удивительно, но все это богатство информации кодируется с помощью всего двух состояний: включено или выключено (единица или ноль). Формирование представления информации называется ее кодированием . В более узком смысле под кодированием понимается переход от исходного представления информации, удобного для восприятия человеком, к представлению, удобному для хранения, передачи и обработки. В этом случае обратный переход к исходному представлению называется декодированием .

При любых видах работы с информацией всегда идет речь о ее представлении в виде определенных символических структур. Наиболее распространены одномерные представления информации, при которых сообщения имеют вид последовательности символов. Так информация представляется в письменных текстах, при передаче по каналам связи, в памяти ЭВМ . Однако широко используется и многомерное представление информации, причем под многомерностью понимается не только расположение элементов информации на плоскости или в пространстве в виде рисунков, схем, графов, объемных макетов и т.п., но и множественность признаков используемых символов, например цвет, размер, вид шрифта в тексте.

Драйвер - это программа-посредник между оборудованием и другими программами.

Таким образом, тексты хранятся на диске или в памяти в виде чисел и программным способом преобразовываются в изображения символов на экране.

1.2.5. Кодирование изображений

В 1756 году выдающийся русский ученый Михаил Васильевич Ломоносов (1711 -1765) впервые высказал мысль, что для воспроизведения любого цвета в природе достаточно смешать в определенных пропорциях три основных цвета: красный, зеленый, синий. Теория трехкомпонентности цвета утверждает, что в зрительной системе человека возникают нервные возбуждения трех типов, каждое из которых независимо от остальных.

Компьютерное кодирование изображений также построено на этой теории. Картинка разбивается вертикальными и горизонтальными линиями на маленькие прямоугольники. Полученная матрица прямоугольников называется растром , а элементы матрицы - пикселями (от англ. Picture"s element - элемент изображения). Цвет каждого пикселя представлен тройкой значений интенсивности трех основных цветов. Такой метод кодирования цвета называется RGB (от англ. red - красный, green - зеленый, blue - синий). Чем больше битов выделено для каждого основного цвета, тем большую гамму цветов можно хранить про каждый элемент изображения. В стандарте, называемом true color (реальный цвет), на каждую точку растра тратится 3 байта, по 1 байт на каждый основной цвет. Таким образом, 256 (=2 8) уровней яркости красного цвета, 256 уровней яркости зеленого цвета и 256 уровней яркости синего цвета дают вместе примерно 16,7 млн различных цветовых оттенков, это превосходит способность человеческого глаза к цветовосприятию.

Чтобы хранить всю картинку, достаточно записывать в некотором порядке матрицу значений цветов пикселей, например, слева направо и сверху вниз. Часть информации о картинке при таком кодировании потеряется. Потери будут тем меньше, чем мельче пиксели. В современных компьютерных мониторах с диагональю 15 -17 дюймов разумный компромисс между качеством и размером элементов картинки на экране обеспечивает растр в 768х1024 точки.

от лат. ?nf?rm?tio - разъяснение, изложение). Одно из значений термина - сведения, сообщаемые различными способами: устными, письменными, техническими, изобразительными и т.д., а также процесс передачи этих сведений. К середине ХХ в. «информация» становится одним из центральных понятий кибернетики и приобретает общенаучное значение; появляется специальная отрасль знаний - информатика.

Отличное определение

Неполное определение ↓

Информация

лат. informatio - ознакомление, представление. 1) любые сведения, данные, сообщения, передаваемые посредством сигналов; 2) уменьшение неопределенности в результате передачи сведений, данных, сообщений - в этом качестве И. противопоставляется энтропии. До сер. 20 в. понятие И. относилось только к сведениям и сообщениям, передаваемым человеком с помощью знаковых средств, способность к передаче И. рассматривалась как отличит. характеристика человека - разумного вида, однако с развитием науки и техники понятие И. стало применяться и для характеристики процессов обмена сигналами в живой природе (сигнальное поведение у животных и растений, генетич. передача данных в клетках и т.д.), а также в среде автоматизированных средств. Интерес к изучению информ. процессов, к колич. и кач. оценке И., возникший в нач. 20 в., был обусловлен и развитием логико-математич., логико-семантич. и семиотич. исследований, привлекших внимание к проблемам представленности знаков и значений, и значит. увеличением объемов передаваемой И., и развитием техн. средств ее передачи (телеграф, телефон, радиосвязь, телевидение), происходившим в рамках модернизационных процессов. В пер. трети 20 в. исследования И. преследовали прежде всего цели уточнения процессов ее формализации (означения – см. Означение) и оптимизации условий ее передачи. Однако уже к сер. 20 в. появились первые теор. исследования, сформировавшие в дальнейшем ряд теорий И. - вероятностную, комбинаторную, алгоритмич. и др. Эти теории, разрабатывавшиеся средствами математики, позволили осуществить математич. моделирование процесса передачи И., выявить осн. элементы этого процесса (в классич. схеме, предложенной К. Шенноном, обмен И. включает шесть составляющих: источник - передатчик - канал передачи - приемник - адресат - источник помех), выявить принципы колич. оценки И. (пропускной способности) и степени ее искажения (помехоустойчивости). Разработка этих теорий привела к появлению информатики как науки, предмет к-рой - И. и способы ее передачи. Однако решающее воздействие на развитие исследований в области И. оказало появление автоматизир. средств обработки И. (ЭВМ) и кибернетики - науки о связи, управлении и информ. обработке. Развитие машинной обработки И. стимулировало исследования в области формализации и алгоритмизации (сведения к операциям с элементарными высказываниями) И. и появление развернутых теорий алгоритмического синтаксиса, а также множества языков алгоритмизации и программирования. Попытки алгоритмизации семантич. процессов - означения и понимания - хотя и были далеко не столь успешны, однако оказали значит. влияние на развитие англ. лингвистич. философии и лингвистич. семантики, а также трансформационной грамматики в русле поиска универсального языка записи семантич. характеристик. В кибернетике И. рассматривается в более узком понимании - не как любые сведения, а только как сведения, ведущие к уменьшению неопределенности (снижению количества возможных альтернативных вариантов) в ситуации общения, сведения, направленные на управление и согласование. В соответствии с таким подходом к И. в рамках общих теорий управления получили развитие исследования прагматич. аспектов И. - оценка И. с т.зр. ее актуальности (достаточная, избыточная, излишняя И.), ценности, полезности, адекватности и т.д. В рамках кибернетики стал возможен синтез математич. моделей и теорий И. с теориями социального взаимодействия и коммуникации, существенно обогативший научные представления о коммуникационных и трансляционных процессах в об-ве. На стыке информатики, кибернетики и антропологии получили также развитие нейроинформ. и нейролингвистич. исследования, рассматривавшие процессы передачи И. на уровне высшей нервной деятельности. Применительно к социокультурному материалу математич. модели И. претерпели существ. трансформацию. Было установлено, что на информ. процессы в человеч. сооб-ве помимо шести осн. элементов существенно влияют также барьеры и фильтры: внутренние (индивидуальные психич. особенности участников информ. обмена, их опыт и компетентность), и внешние (социальные и культурные нормы, ценности, коллективные представления), значительно трансформирующие, искажающие И., и при этом они не всегда носят рац. характер. Колич. оценки этих искажающих влияний (помех) совершенно недостаточно, поскольку индивидуальный характер и сложность природы этих влияний делают принципиально необходимым их содержат. кач. анализ и определение механизмов их воздействия на И. Информ. процессы в человеч. сооб-ве далеко не всегда можно интерпретировать как ведущие к снижению неопределенности ситуации, и неактуальная информация (шум) имеет здесь не меньшее значение, чем актуальная. В соответствии с этим, помимо актуальности для социально и культурно значимой И. важны адекватность, достоверность, полнота, новизна, убедительность, выразительность, воспринимаемость и т.д. Понимание того, что информ. процессы являются важной составляющей любой культурной общности (истор. и современной), и применение к их изучению методов математич. моделирования (частично осуществленное структурализмом и европ. социальной антропологией) существенно обогатило теоретико-методол. багаж социокультурных наук. Функциональный подход к И. получил дальнейшее развитие в теории коммуникации. В рамках семиотики (см. Семиотика) изучение И. осуществляется в основном в ее семантич. аспектах (И. как пространство смыслов и значений). В настоящее время изучение И. в социокультурных науках осуществляется по двум направлениям: 1) изучение информ. процессов (информ. культуры) разл. культурных общностей (гос-в, этносов, цивилизаций и т.д.); 2) исследования локальных информ. процессов в разл. видах деятельности (менеджмент, маркетинг, реклама, социальное участие, полит. деятельность и т.д.). Исследования такого рода, как правило, имеют прикладную направленность и наиболее широко привлекают достижения информатики и кибернетики. Такие исследования посвящены прежде всего совр. проблемам информ. обмена. Прогрессирующая активизация и глобализация информ. процессов (средства массовой информации, массовая культура, глобальные информ. сети и т.д.) в культуре на протяжении всего 20 в. определили признание исключит. важности информ. процессов для развития совр. об-ва и сделали И. предметом не только научного, но и философского рассмотрения. И. интерпретировалась в культурфилософии, как правило, в рамках общих представлений того или иного направления (для неотомизма характерно представление И. как трансцендентального феномена; для экзистенциализма и феноменологии - ориентация на ее субъективистскую трактовку; для филос. герменевтики (см. Герменевтика) - стремление обусловить информ. процессы культурным опытом, для постпозитивизма - акцент на некогнитивные аспекты И.). Совр. ситуация нередко характеризуется культур-философией как “информ. взрыв”, “информ. бум”, обработка И. рассматривается как осн. вид деятельности в формирующемся “постиндустриальном об-ве”, предпринимаются попытки ее филос. истолкования и предсказания возможных путей развития “информ. цивилизации”. Лит. : Шеннон К.Э. Работы по теории информации и кибернетики. М., 1963; Пирс Дж. Символы, сигналы, шумы. Закономерности и процессы передачи информации. М., 1967; Винер Н. Кибернетика или управление и связь в животном и машине. М., 1968; Гришкин И.И. Понятие информации. М., 1973; Афанасьев В.Г. Социальная информация и управление об-вом. М., 1975; Стратонович Р.Л. Теория информации. М., 1975; Дубровский Д.И. Информация, сознание, мозг. М., 1980; Страссман П.А. Информация в век электроники: Пробл. управления. М., 1987; Кин Дж. Средства массовой информации и демократия. М., 1994; Брой М. Информатика. Основополагающее введение. Ч. 1-3. М., 1996; Федотова Л.Н. Массовая информация: Стратегия производства и тактика потребления. М., 1996; Иванов А.М., Козлов В.И. Информация. Информатика. Компьютер. Самара,1996. А. Г. Шейкин. Культурология ХХ век. Энциклопедия. М.1996

В стремлении дать определение понятию И. ученые прошли за последние 50 лет эволюцию от формальных (преимущественно теоретико-математических) дефиниций того, что собой представляет и как может измеряться количество И., до новейших попыток построения универсальных концепций информационного общества, универсального метаязыка, всеобщей метатеории и т. п. Парадоксальность многих из этих концепций заключается в том, что само понятие И. в них не определяется, а принимается на интуитивном уровне. Отсюда понятен профессиональный интерес к осмыслению феномена И. среди философов.

Разработки в области теории И. содействовали сдвигам в методологии научного познания, которые нашли выражение в смещении акцентов от вещи к отношению, от поисков универсальной первоосновы бытия к признанию разнообразия в качестве базового принципа научного исследования. Именно эти категории философии - отношение и разнообразие - занимают сегодня центральное место в попытках определить природу информационных явлений.

Вместе с тем многочисленные исследования феномена И. обнаружили его связь с организацией, системностью, упорядоченностью, структурой, а также с функциональными состояниями и процессами в сложных системах управления. И тогда И. предстает как функциональное свойство процессов управления, неотделимое от последних, а теория И. - как раздел кибернетики.

Из научно-технических разработок по теории И. родились специализированные научные дисциплины. Это информатика (комбинация из слов "информация" и "автоматика") - область изучения научно-технической И., ориентирующаяся на автоматизированную обработку данных, массивов знаний производственно-технического и социального назначения с использованием вычислительной техники, средств связи и математико-программного обеспечения. Другая научная дисциплина - информология (наука об И.) - область изучения И. как фундаментального фактора бытия, закономерностей производства, передачи, получения, хранения и использования И.

Теория И. в узком смысле (математическая теория связи) - область изучения информационных процессов со стороны количества И., проходящей по каналам связи, запоминаемой и т. п.; в ней рассматриваются вопросы оптимального кодирования сообщений в форму сигнала, максимальной пропускной способности каналов связи и др., (вопрос о содержании сообщения (сигнала) обычно выносится за рамки этой теории).

Основные исторические этапы информационной эволюции общества обусловлены появлением различных носителей информации: письменности, книгопечатания, современной информационно-кибернетической (в частности, вычислительной) техники. В наше время понятие И. ассоциируется с компьютерами, рекламой, издательской деятельностью, телевидением, радио- и телеграфной связью, другими средствами массовой информации (СМИ). В науку это понятие введено в 1928 г. Р. Хартли (США) для обозначения меры количественного измерения сведений, распространяемых по техническим каналам связи (заметим, безотносительно к содержанию этих сведений). Последние, ввиду ограниченных возможностей фиксации и передачи устной речи, преобразуются источником И. сначала в форму языкового (знакового) сообщения, а затем передатчиком во вторичную, удобную для трансляции по техническим каналам связи форму сигнала, что предполагает операцию кодирования с последующим декодированием на стороне приемника. Тем самым получатель имеет на выходе приемника сообщение, которое при минимизации помех ("шума") представляет собой, с определенной степенью соответствия, копию сообщения на стороне источника. Заметим, что доведение И. до адресата (получателя), если эта И. не является ложной (дезинформацией), всегда приводит к уменьшению неопределенности в знаниях и действиях последнего. Хартли предложил логарифм при основании два для вычисления количества И. как меры неопределенности, устраняемой в результате получения И. у того, кто эту И. получает. Так возникла единица И. - бит, или "одно из двух": либо "да", либо "нет" по отношению к вопросу, фиксирующему неопределенность знаний или сведений получателя о чем-либо его интересующем. В 40-е гг. другой американский ученый К. Шеннон, специализировавшийся в вопросах пропускной способности каналов связи и кодирования сообщений, придал этой мере количества И. более универсальную форму: количество И. стало пониматься как величина энтропии, на которую уменьшается общая энтропия системы в результате получения этой системой И. Формула эта выражает энтропию через сумму целого ряда вероятностей, помноженных на их логарифмы, и относится только к энтропии (неопределенности) сообщения.

Иными словами, информативность сообщения обратно пропорциональна его очевидности, предсказуемости, вероятности: чем менее предсказуемо, неочевидно и маловероятно сообщение, тем больше И. оно несет для получателя. Совершенно очевидное (с вероятностью, равной 1) сообщение столь же пусто, сколь полное отсутствие такового (т. е. сообщения, вероятность которого заведомо равна 0). Оба они, согласно допущению Шеннона, неинформативны, не несут получателю никакой И. По ряду причин, относящихся к математике и связанных с удобствами формализации, энтропия сообщения описывается Шенноном как функция распределения случайных величин.

Проблема И. многоаспектна не только в общенаучном, но и в философском смысле. В онтологическом и мировоззренческом аспектах предпринимаются попытки раскрыть соотношение И. с веществом и энергией, ее природу и статус в структуре бытия; в гносеологическом аспекте - соотнести И. с содержанием и формой знания, с образами, знаками, моделями и т. п.; в логико-методологическом аспекте - выявить количественно-математические, измеримые стороны информационных процессов в математической теории связи, моделях массовых коммуникаций, кибернетике.

В 60 - 80-е гг. многие результаты, полученные в исследованиях предыдущего двадцатилетия, были эксплицированы в связи с исследованиями кибернетических моделей машинного перевода с одного языка на другой, теории игр и принятия решений, распознавания образов. Наряду с дальнейшей разработкой статистической (синтаксической) концепции И. появились семантические и прагматические концепции. Стало ясно, что работы Фишера, Найквиста, Хартли и Шеннона, будучи попыткой количественной экспликации качественного понятия И. как сведений, сообщений, не дают ответа на вопрос, о количестве какого качества идет речь. Интерпретация И. в этих работах носит формальный, абстрактно-математический характер. Исходным принципом создания сообщения служит принцип последовательного выбора его знак за знаком, буква за буквой из бесконечного резервуара готовых сообщений (ансамбля), и создание индивидуального сообщения есть его статистический выбор из ансамбля. Сообщения между собой статистически однородны (свойство эргодичности), поэтому математическую теорию связи интересуют индивидуальные различия сообщений, равно как и количество И., содержащейся в индивидуальном сообщении. Определимо лишь среднее количество И., приходящейся на одно сообщение в случае его выбора. Но И. выбора сообщения не есть И.. самого сообщения (Е. К. Войшвилло). Индивидуальность события не должна исчезать в однородности статистического ансамбля. Более того, А. Н. Колмогоровым и его учениками было показано, что статистическое понятие И. выражает не абсолютное ее количество, а дополнительную И., дополнение к имеющемуся у получателя информационному содержанию.

Этим был дан толчок, во-первых, разработке т. н. тезаурусной модели и, как следствие, семантической и прагматической концепций И., во-вторых, уточнению взаимосвязи между И. и разнообразием.

В 80-е и особенно в 90-е гг. обозначилась тенденция заметного размежевания специалистов в области теории И. на пессимистов и оптимистов, критиков и апологетов. Из области семантики и математических проблем теории связи дискуссии переместились в социально-этическую и политическую сферы проблем информационного общества. Объективной основой этих изменений стали громадные преимущества, которые дает развитие информационной инфраструктуры обладающим ею государствам и регионам, организациям и физическим лицам: возможность сжатой во времени переработки больших массивов И., практически мгновенной коммуникативной связи в пределах земного шара, проектирования сложных систем и управления ими и др. В ряде работ термин "информационное общество" символизирует по существу новую социальную парадигму (О. Тоффлер), исторически новый и особый тип цивилизации, идущей на смену сельскохозяйственной и индустриальной. Реальные преимущества, в возрастающей степени получаемые государствами и регионами (США, Европа, Япония) с развитыми И. технологиями и компьютерными сетями, приводят к изменению характера экономических, политических и социальных отношений, семьи, быта, досуга, образа жизни, переворачивают традиционные представления о ценности сельскохозяйственного и индустриального производства. И одновременно информатизация всех сфер жизнедеятельности современного человека, с т. зр. ее пессимистически настроенных критиков, сопровождается дегуманизацией, порождает новую и неизвестную предыдущим эпохам виртуальную реальность существования в иллюзорном мире. С социально-психологической т. зр., информатизация разрушает привычные природные ритмы и циклы жизнедеятельности людей; с нравственно-этической - вытесняет ценность и привлекательность живого общения, сопереживания, понимания; с политической - резко усиливает возможности манипулирования массовым и индивидуальным сознанием, влияния "четвертой власти" - СМИ, изменяет потенциал властных элит, в т. ч. посредством перемещения полномочий и возможностей последних из внутригосударственной сферы в область иерархии межгосударственных отношений.

С социально-исторической т. зр., негативные проявления информатизации могут быть обозначены как апофеоз рациональности, доведение европейского классического типа рациональности до логически завершенной формы информационного господства в масштабах планеты. В современной типологии исследований И. среди "оптимистов" заметна тенденция разработки на основе теории И. всеобщей метатеории и всеобщего информационного метаязыка для научных и вненаучных областей знания. Известный российский исследователь И. И. Юзвишин, разрабатывая новую обобщенную науку - информациологию (1993), предлагает концепции И. кода человека и Вселенной, информационные подходы к сохранению здоровья и увеличению долголетия, построению нового мирового сообщества и др. Цель будущего видится в создании единого мирового распределенного информационно-сотового сообщества новой информационной цивилизации, а в гносеологическом аспекте - в революционном прорыве посредством И. в трансцендентные миры.

Информация (от лат. informatio, разъяснение, изложение, осведомленность) - общенаучное понятие, связанное с объективными свойствами материи и их отражением в человеческом сознании.

В современной науке рассматриваются два вида информации.

Объективная (первичная) информация - свойство материальных объектов и явлений (процессов) порождать многообразие состояний, которые посредством взаимодействий (фундаментальные взаимодействия) передаются другим объектам и запечатлеваются в их структуре.(см.В.М. Глушков, Н.М. Амосов и др. «Энциклопедия кибернетики». Киев. 1975 г.)

Субъективная (семантическая,смысловая, вторичная) информация – смысловое содержание объективной информации об объектах и процессах материального мира, сформированное сознанием человека с помощью смысловых образов (слов, образов и ощущений) и зафиксированное на каком-либо материальном носителе. Человеку свойственно субъективное восприятие информации через некоторый набор ее свойств: важность, достоверность, своевременность, доступность, «больше-меньше» и т.д. Использование терминов «больше информации» или «меньше информации» подразумевает некую возможность ее измерения (или хотя бы количественного соотнесения). При субъективном восприятии измерение информации возможно лишь в виде установления некоторой субъективной порядковой шкалы для оценки «больше-меньше». При объективном измерении количества информации следует заведомо отрешиться от восприятия ее с точки зрения субъективных свойств, примеры которых перечислены выше. Более того, не исключено, что не всякая информация будет иметь объективно измеряемое количество.

В бытовом смысле информация - сведения об окружающем мире и протекающих в нем процессах, воспринимаемые человеком или специальным устройством.{см.С.И.Ожегов. "Словарь русского языка". Москва. 1990г.). В простейшем бытовом понимании с термином «информация» обычно ассоциируются некоторые сведения, данные , знания и т.п. Информация передается в виде сообщений, определяющих форму и представление передаваемой информации. Примерами сообщений являются музыкальное произведение; телепередача; команды регулировщика на перекрестке; текст, распечатанный на принтере; данные, полученные в результате работы составленной вами программы, и т.д. При этом предполагается, что имеются «источник информации» и «получатель информации». Сообщение от источника к получателю передается посредством какой-нибудь среды, являющейся в таком случае «каналом связи». Так, при передаче речевого сообщения в качестве канала связи можно рассматривать воздух, в котором распространяются звуковые волны, а в случае передачи письменного сообщения (например, текста, распечатанного на принтере) каналом сообщения можно считать лист бумаги, на котором напечатан текст. Чтобы сообщение было передано от источника к получателю, необходима некоторая материальная субстанция - носитель информации. Сообщение, передаваемое с помощью носителя, - сигнал. В общем случае сигнал - это изменяющийся во времени физический процесс. Та из характеристик процесса, которая используется для представления сообщений, называется параметром сигнала. В случае, когда параметр сигнала принимает последовательное во времени конечное число значений (при этом все они могут быть пронумерованы), сигнал называется дискретным, а сообщение, передаваемое с помощью таких сигналов, - дискретным сообщением. Если же источник вырабатывает непрерывное сообщение (соответственно параметр сигнала - непрерывная функция от времени), то соответствующая информация называется непрерывной. Примеры дискретного сообщения - текст книги, непрерывного сообщения - человеческая речь, передаваемая модулированной звуковой волной; параметром сигнала в последнем случае является давление, создаваемое этой волной в точке нахождения приемника - человеческого уха. Непрерывное сообщение может быть представлено непрерывной функцией, заданной на некотором интервале. Непрерывное сообщение можно преобразовать в дискретное (такая процедура называется дискретизацией). Из бесконечного множества значений параметра сигнала выбирается их определенное число, которое приближенно может характеризовать остальные значения. Для этого область определения функции разбивается на отрезки равной длины и на каждом из этих отрезков значение функции принимается постоянным и равным, например, среднему значению на этом отрезке. В итоге получим конечное множество чисел. Таким образом, любое непрерывное сообщение может быть представлено как дискретное, иначе говоря, последовательностью знаков некоторого алфавита. Возможность дискретизации непрерывного сигнала с любой желаемой точностью (для возрастания точности достаточно уменьшить шаг) принципиально важна с точки зрения информатики. Компьютер - цифровая машина, т.е. внутреннее представление информации в нем дискретно. Дискретизация входной информации (если она непрерывна) позволяет сделать ее пригодной для компьютерной обработки.

Понятие «информация» является одним из фундаментальных в современной науке вообще и базовым для информатики. Информацию наряду с веществом и энергией рассматривают в качестве важнейшей сущности мира, в котором мы живем. Однако если задаться целью формально определить понятие «информация», то сделать это будет чрезвычайно сложно. В настоящее время не существует единого определения информации как научного термина. С точки зрения различных областей знания, данное понятие описывается своим специфическим набором признаков. Согласно концепции К.Шеннона, информация - это снятая неопределенность, т.е. сведения, которые должны снять в той или иной степени существующую у потребителя до их получения неопределенность, расширить его понимание объекта полезными сведениями.

Единицы количества информации

Определить понятие «количество информации» довольно сложно. В решении этой проблемы существуют два основных подхода. Исторически они возникли почти одновременно. В конце 40-х годов XX века один из основоположников кибернетики, американский математик Клод Шеннон, развил вероятностный подход к измерению количества информации, а работы по созданию ЭВМ привели к «объемному» подходу.

Вероятностный подход

Рассмотрим в качестве примера опыт, связанный с бросанием правильной игральной кости, имеющей N граней. Результаты данного опыта могут быть следующие: выпадение грани с одним из следующих знаков: 1, 2, ..., N .

Введем в рассмотрение численную величину, измеряющую неопределенность - энтропию (обозначим ее Н ). Согласно развитой теории, в случае равновероятного выпадания каждой из граней величины N и Н связаны между собой формулой Хартли

Важным при введении какой-либо величины является вопрос о том, что принимать за единицу ее измерения. Очевидно, H будет равно единице при N = 2. Иначе говоря, в качестве единицы принимается количество информации, связанное с проведением опыта, состоящего в получении одного из двух равновероятных исходов (примером такого опыта может служить бросание монеты, при котором возможны два исхода: «орел», «решка»). Такая единица количества информации называется «бит».

В случае, когда вероятности Рi результатов опыта (в примере, приведенном выше, - бросания игральной кости) неодинаковы, имеет место формула Шеннона

В случае равновероятности событий , формула Шеннона переходит в формулу Хартли.

В качестве примера определим количество информации, связанное с появлением каждого символа в сообщениях, записанных на русском языке. Будем считать, что русский алфавит состоит из 33 букв и знака «пробел» для разделения слов. По формуле Хартли

Однако в словах русского языка (равно как и в словах других языков) различные буквы встречаются неодинаково часто. Ниже приведена таблица вероятностей частоты употребления различных знаков русского алфавита, полученная на основе анализа очень больших по объему текстов.

Объемный подход

В двоичной системе счисления знаки 0 и 1 называют битами (bit - от английского выражения Binary digiTs - двоичные цифры). В компьютере бит является наименьшей возможной единицей информации. Объем информации, записанной двоичными знаками в памяти компьютера или на внешнем носителе информации, подсчитывается просто по числу требуемых для такой записи двоичных символов. При этом, в частности, невозможно нецелое число битов (в отличие от вероятностного подхода).

Для удобства использования введены и более крупные, чем бит , единицы количества информации. Так, двоичное слово из восьми знаков содержит один байт информации. 1024 байта образуют килобайт (Кбайт), 1024 килобайта - мегабайт (Мбайт), а 1024 мегабайта - гигабайт (Гбайт).

Между вероятностным и объемным количеством информации соотношение неоднозначное. Далеко не всякий текст, записанный двоичными символами, допускает измерение объема информации в вероятностном (кибернетическом) смысле, но заведомо допускает его в объемном. Далее, если некоторое сообщение допускает измеримость количества информации в обоих смыслах, то это количество не обязательно совпадает, при этом кибернетическое количество информации не может быть больше объемного.

В прикладной информатике практически всегда количество информации понимается в объемном смысле.

Классификация информации

Информацию можно разделить на виды по разным критериям.

Способ восприятия: Визуальная - воспринимаемая органами зрения. Аудиальная - воспринимаемая органами слуха. Тактильная - воспринимаемая тактильными рецепторами. Обонятельная - воспринимаемая обонятельными рецепторами. Вкусовая - воспринимаемая вкусовыми рецепторами.

Форма представления: Текстовая - передаваемая в виде символов, предназначенных обозначать лексемы языка. Числовая - в виде цифр и знаков, обозначающих математические действия. Графическая - в виде изображений, предметов, графиков. Звуковая - устная или в виде записи передача лексем языка аудиальным путём.

Предназначение: Массовая - содержит тривиальные сведения и оперирует набором понятий, понятным большей части социума. Специальная - содержит специфический набор понятий, при использовании происходит передача сведений, которые могут быть не понятны основной массе социума, но необходимы и понятны в рамках узкой социальной группы, где используется данная информация. Личная - набор сведений о какой-либо личности, определяющий социальное положение и типы социальных взаимодействий внутри популяции.

Свойства информации

Качество информации - степень её соответствия потребностям потребителей. Свойства информации являются относительными, так как зависят от потребностей потребителя информации.

Объективность информации характеризует её независимость от чьего-либо мнения или сознания, а также от методов получения. Более объективна та информация, в которую методы получения и обработки вносят меньший элемент субъективности.

Информацию можно считать полной , когда она содержит минимальный, но достаточный для принятия правильного решения набор показателей. Как неполная, так и избыточная информация снижает эффективность принимаемых на основании информации решений.

Достоверность - верность информации, не вызывающая сомнений. Объективная информация всегда достоверна, но достоверная информация может быть как объективной, так и субъективной. Причинами недостоверности могут быть: преднамеренное искажение (дезинформация); непреднамеренное искажение субъективного свойства; искажение в результате воздействия помех; ошибки фиксации информации. В общем случае достоверность информации достигается: указанием времени свершения событий, сведения о которых передаются; сопоставлением данных, полученных из различных источников; своевременным вскрытием дезинформации; исключением искажённой информации и др.

Адекватность - степень соответствия смысла реально полученной информации и её ожидаемого содержимого. Например задан вопрос - "Сколько у человека пальцев на руке?" "На руке у человека пять пальцев" - ответ достоверный и адекватный, "У человека две руки" - ответ достоверный но неадекватный.

Доступность информации - мера возможности получить ту или иную информацию.

Актуальность информации - это степень соответствия информации текущему моменту времени.

Эмоциональность - свойство информации вызывать различные эмоции у людей. Это свойство информации используют производители медиаинформации. Чем сильнее вызываемые эмоции, тем больше вероятности обращения внимания и запоминания информации.

Как ни важно измерение информации, нельзя сводить к нему все связанные с этим понятием проблемы. При анализе информации социального (в широким смысле) происхождения на первый план могут выступить такие ее свойства, как истинность, своевременность, ценность, полнота и т.д. Их невозможно оценить в терминах «уменьшение неопределенности» (вероятностный подход) или числа символов (объемный подход). Обращение к качественной стороне информации породило иные подходы к ее оценке. При аксиологическом подходе стремятся исходить из ценности, практической значимости информации, т.е. из качественных характеристик, значимых в социальной системе. При семантическом подходе информация рассматривается с точки зрения как формы, так и содержания. При этом информацию связывают с тезаурусом, т.е. полнотой систематизированного набора данных о предмете информации. Эти подходы не исключают количественного анализа, но он становится существенно сложнее и должен базироваться на современных методах математической статистики.

Понятие информации

Понятие информации нельзя считать лишь техническим, междисциплинарным и даже наддисциплинарным термином. Информация - это фундаментальная философская категория. Дискуссии ученых о философских аспектах информации надежно показали несводимость информации ни к одной из этих категорий. Концепции и толкования, возникающие на пути догматических подходов, оказываются слишком частными, односторонними, не охватывающими всего объема этого понятия.

Попытки рассмотреть категорию информации с позиций основного вопроса философии привели к возникновению двух противостоящих концепций - функциональной и атрибутивной. «Атрибутисты» квалифицируют информацию как свойство всех материальных объектов, т.е. как атрибут материи. «Функционалисты» связывают информацию лишь с функционированием сложных, самоорганизующихся систем.

Можно попытаться дать философское определение информации с помощью указания на связь определяемого понятия с категориями отражения и активности. Информация есть содержание образа, формируемого в процессе отражения. Активность входит в это определение в виде представления о формировании некоего образа в процессе отражения некоторого субъект-объектного отношения. При этом не требуется указания на связь информации с материей, поскольку как субъект, так и объект процесса отражения могут принадлежать как к материальной, так и к духовной сфере социальной жизни. Однако существенно подчеркнуть, что материалистическое решение основного вопроса философии требует признания необходимости существования материальной среды - носителя информации в процессе такого отражения. Итак, информацию следует трактовать как имманентный (неотъемлемо присущий) атрибут материи, необходимый момент ее самодвижения и саморазвития. Эта категория приобретает особое значение применительно к высшим формам движения материи - биологической и социальной.

Известно большое количество работ, посвященных физической трактовке информации. Эти работы в значительной мере построены на основе аналогии формулы Больцмана, описывающей энтропию статистической системы материальных частиц, и формулы Хартли. Соответствующие материалы можно найти в литературе, отраженной в приведенном ниже перечне.

Информацию следует считать особым видом ресурса, при этом имеется в виду толкование «ресурса» как запаса неких знаний материальных предметов или энергетических, структурных или каких-либо других характеристик предмета. В отличие от ресурсов, связанных с материальными предметами, информационные ресурсы являются неистощимыми и предполагают существенно иные методы воспроизведения и обновления, чем материальные ресурсы. В связи с таким взглядом центральными становятся следующие свойства информации: запоминаемость, передаваемость, преобразуемость, воспроизводимость, стираемостъ.

Подводя итог сказанному, отметим, что предпринимаются (но отнюдь не завершены) усилия ученых, представляющих самые разные области знания, построить единую теорию, которая призвана формализовать понятие информации и информационного процесса, описать превращения информации в процессах самой разной природы. Движение информации есть сущность процессов управления, которые суть проявление имманентной активности материи, ее способности к самодвижению. С момента возникновения кибернетики управление рассматривается применительно ко всем формам движения материи, а не только к высшим (биологической и социальной). Многие проявления движения в неживых - искусственных (технических) и естественных (природных) системах также обладают общими признаками управления, хотя их исследуют в химии, физике, механике в энергетической, а не в информационной системе представлений. Информационные аспекты в таких системах составляют предмет новой междисциплинарной науки - синергетики.

Высшей формой информации, проявляющейся в управлении в социальных системах, являются знания. Это наддисциплинарное понятие, широко используемое в педагогике и исследованиях по искусственному интеллекту, также претендует на роль важнейшей философской категории. В философском плане познание следует рассматривать как один из функциональных аспектов управления. Такой подход открывает путь к системному пониманию генезиса процессов познания, его основ и перспектив.

Данные, информация и знания

К базовым понятиям, которые используются в экономической информатике, относятся: данные, информация и знания. Эти понятия часто используются как синонимы, однако между этими понятиями существуют принципиальные различия.

Термин данные происходит от слова data - факт, а информация (informatio) означает разъяснение, изложение, т.е. сведения или сообщение.

Данные - это совокупность сведений, зафиксированных на определенном носителе в форме, пригодной для постоянного хранения, передачи и обработки. Преобразование и обработка данных позволяет получить информацию.

Информация - это результат преобразования и анализа данных. Отличие информации от данных состоит в том, что данные - это фиксированные сведения о событиях и явлениях, которые хранятся на определенных носителях, а информация появляется в результате обработки данных при решении конкретных задач. Например, в базах данных хранятся различные данные, а по определенному запросу система управления базой данных выдает требуемую информацию.

Существуют и другие определения информации, например, информация – это сведения об объектах и явлениях окружающей среды, их параметрах, свойствах и состоянии, которые уменьшают имеющуюся о них степень неопределенности, неполноты знаний.

Знания – это зафиксированная и проверенная практикой обработанная информация, которая использовалась и может многократно использоваться для принятия решений.

Знания – это вид информации, которая хранится в базе знаний и отображает знания специалиста в конкретной предметной области. Знания – это интеллектуальный капитал.

Формальные знания могут быть в виде документов (стандартов, нормативов), регламентирующих принятие решений или учебников, инструкций с описанием решения задач. Неформальные знания – это знания и опыт специалистов в определенной предметной области.

Необходимо отметить, что универсальных определений этих понятий (данных, информации, знаний) нет, они трактуются по-разному. Принятия решений осуществляются на основе полученной информации и имеющихся знаний.

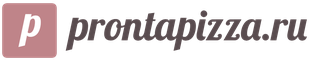

Принятие решений – это выбор наилучшего в некотором смысле варианта решения из множества допустимых на основании имеющейся информации. Взаимосвязь данных, информации и знаний в процессе принятия решений представлена на рисунке.

Взаимосвязь данных, информации и знаний в процессе принятия решений

Для решения поставленной задачи фиксированные данные обрабатываются на основании имеющихся знаний, далее полученная информация анализируется с помощью имеющихся знаний. На основании анализа, предлагаются все допустимые решения, а в результате выбора принимается одно наилучшее в некотором смысле решение. Результаты решения пополняют знания.

В зависимости от сферы использования информация может быть различной: научной, технической, управляющей, экономической и т.д. Для экономической информатики интерес представляет экономическая информация.

Литература

- Могилев А.В. Практикум по информатике: Учеб. пособие для студ. высш. учеб. заведений/А.В.Могилев, Н.И.Пак, Е.К.Хеннер; Под ред. Е.К.Хеннера. - 2-е изд., стер. - М.: Издательский центр "Академия", 2005. - 608 с.

Информация - один из элементов мышления, включающий факты, наблюдения, личные переживания, и нередко основным для нас становится именно последний компонент. Однако, основываясь на своём опыте как на единственном источнике, мы ступаем на скользкую дорожку искажений: так, опыт, выросший из предубеждений, будет распространять предубеждение, а опыт, порождённый самообманом, соответственно, будет поддерживать самообман. Именно поэтому мы должны лишить опыт аксиоматической истинности и подвергать его критическому осмыслению наравне с другими источниками.

По словам философа Р. Пола, первым шагом на этом пути является понимание того, что мы получаем информацию тремя различными способами: в своей статье учёный окрестил их «пассивной информацией», «активным невежеством» и «активным знанием».

Итак, какова же разница между ними и какой из способов более всего подходит для тех, кто хочет научиться мыслить критически?

«Не понял, но запомнил», или как уничтожить пассивную информацию

Под пассивной информацией Пол подразумевает запоминание фактов и суждений, которые мы не до конца осмыслили, хотя и готовы поспорить с этим, уверенные, что всё прекрасно поняли.

Например, из урока обществознания мы запоминаем, что такое «демократия», и умение воспроизвести вызубренное определение заставляет многих считать, что они действительно понимают, что означает это слово.

На самом же деле нам известен лишь «словесный ритуал», набор общих фраз, едва ли характеризующих явление. Мы охотно повторяем за А. Линкольном, что «демократия - это правление народа, избранное народом и для народа», но как броская цитата, эпиграфом красующаяся на страницах учебника, помогает понять, чем отличается этот политический режим от иных? Большинство людей, раз за разом используя терминологическое клише, с трудом могли бы ответить на вопросы, предлагаемые Полом для самопроверки:

В чём разница между «правлением народа» и «правлением для народа»? А между «правлением для народа» и «правлением народа, избранным народом»? «Правлением народа, избранным народом» - и «правлением народа»? И что вообще подразумевается под «народом»?

Неосмысленная информация оседает в нас штампами. Это можно рассмотреть на примере других, более простых концептов, из которых в нашем сознании конструируется окружающий мир: «солнце», «дерево», «река», «люди», «дом»... Превращение явления или предмета в концепт происходит естественно: концептуализируя, мы встраиваем понятие в систему образов; ни один из концептов не живёт обособленно, что подтверждает наша склонность объяснять одно другим.

Например, как бы мы объяснили, кто такой «просветитель»? «Тот, кто распространяет передовые идеи», отвечаем мы - и для толкования привлекаем ключевое в этом определении понятие «передовые идеи». Но что подразумевается под «передовыми идеями»? Объясняя, мы снова будем задействовать концепты, подбирая синонимы или «говорящие» примеры. Разбор концептов на составляющие - отличный метод для проверки того, насколько мы разобрались в том или ином понятии.

Чем «смелость» отличается от «фривольности»? А «жадность» - от «экономности»? Когда уместно говорить «разоблачать», а когда - «обличать»? «Власть» и «контроль» - это одно и то же? Чтобы уметь добираться до истинных значений, нужно отринуть «наивные» трактовки, которые искажают смысл поверхностностью.

Не понимая и неверно употребляя слова, мы продолжим множить бессмыслицу в духе «свободная вакансия», «патриот родины» или «главный приоритет». Зубрёжка определений, искусственно загружающая в нас информацию, не приблизит понимание, а вот лишний раз заглянуть в толковый словарь - решение куда более конструктивное.

Понимание концептов позволяет нам расшифровывать код языка и избавляться от неглубокого восприятия, а значит, если и не принимать, то хотя бы допускать альтернативные точки зрения на одно и то же явление. Так мы излечиваемся от узости мышления, возникающей за счёт фокуса исключительно на своей позиции - или на тех стереотипах, что были привиты мировоззрением нашей социальной группы.

Таким образом, чтобы освободиться от пассивного знания, нужно пройти краткий курс информационного детокса: выявить то, что нам на самом деле неясно (и часто именно этот этап является самым сложным), и трансформировать непонятое в осмысленное посредством анализа.

«Я в это верю и я прав», или почему активное невежество ведёт к страданию

Под активным невежеством понимается принятие и использование ложной информации, которую мы считаем достоверной. Пол приводит в пример концепцию Р. Декарта: учёный считал, что животные - всего лишь «автоматы», не имеющие разума, а значит, и не чувствующие боли.

Р. Декарт

Животные разума не имеют, и природа в них действует согласно расположению их органов, подобно тому как часы, состоящие только из колёс и пружин, точнее показывают и измеряют время, чем мы со всем нашим разумом.

Отталкиваясь от этой идеи, учёный провёл немало болезненных экспериментов, воспринимая стоны живых существ как «скрипы механизмов».

Пример с Декартом весьма показателен, поскольку под воздействием ложных представлений и принципов, усвоенных нами в качестве истины, мы, зачастую не осознавая, причиняем страдания другим.

Активное невежество может быть как индивидуальным, так и массовым (вспомним о национал-социализме, опирающимся на расовую теорию), но и в том, и другом случае оно одинаково опасно.

Пол предлагает проверять информацию на достоверность при помощи следующих вопросов:

Какая информация нужна мне для ответа?

Какие данные имеют отношение к этой проблеме?

Нужно ли мне найти больше информации?

Соответствует ли эта информация моим целям?

На какой информации мы основываем своё высказывание?

Что убедило нас в этом? Может ли наше видение быть искажённым?

Откуда мы знаем, что эта информация точна?

Не пропустили ли мы какую-то важную информацию?

Тестируя свои убеждения на подлинность, спросите у себя, чем, например, обоснована наша уверенность в том, что мыши обожают сыр? Или почему мы убеждены, что все товары, маркированные припиской «детское», априори безвредны? Иными словами, отфильтровывайте информацию сомнением, чтобы не попасться на крючок активного невежества.

«Я искал и проверял», или где искать активное знание

И пассивная информация, и активное невежество, очевидно, не самые лучше способы знакомиться с новыми фактами, чего не скажешь об активном знании. Под активным знанием Пол подразумевает восприятие верной информации и её грамотное применение.

Учёный приводит в пример типичную подготовку к экзамену по истории: в ночь перед испытанием мы наспех пролистываем учебник или безуспешно пытаемся разобраться в рукописных криптограммах однокурсников. Та информация, которую мы не понимаем и уже вряд ли поймём в связи с нехваткой времени, оседает в сознании в виде заученных абзацев, пополняя резерв пассивной информации.

То же, что мы понимаем превратно («Средние века называют «тёмными» потому, что это время тотального упадка культуры»), становится частью активного невежества.

Хотя, конечно, многое и вовсе выветривается сразу после того, как оценка оказывается в зачётке, что, впрочем, не так уж плохо: незнание лучше усвоения искажённых фактов.

А что насчёт активного знания? Оно станет нам доступно, когда мы поймём логику исторического мышления, осознав, как мыслили люди прошлых эпох, а не оценивая исторические события с точки зрения современности.

Что для этого нужно? Пол советует испробовать простой приём: составьте рассказ о том, что произошло в мире за сегодня. Создавая свою историю, вы будете отбирать и оценивать факты, но едва ли в вашем рассказе будет описано абсолютно всё, что случилось за этот период: вы выберете только то, что, на ваш взгляд, действительно актуально. Более того, рассказывая, вы склонны оценивать каждое событие субъективно (так, если вы против ограничения свобод в интернете, то вряд ли одобрительно воспримете законопроект, который налагает штраф за использование нецензурных выражений в киберпространстве).

Очевидно, что люди, пишущие историю, выстраивают её согласно своим воззрениям и личным целям. То есть:

одно и то же событие может быть рассмотрено через призму разных политических, социальных, культурных концепций;

у разных историков - разные точки зрения (и зачастую разные представления о том, какие события действительно являлись наиболее значимыми в тот или иной период);

когда историк отождествляет себя с определённой социальной группой, нацией или культурой, ему, по понятным причинам, свойственно в своей «летописи» высвечивать положительное этих групп и отрицательное тех, кто был с ними не согласен.

Такие инсайты об истории являются результатом того, что мы пропустили знание через себя, не оставив ему шанса на пассивное прозябание или превращение в невежество. Воспринимая историю не как дисциплину, затвердевшую в веках, а как живой текст, создающийся прямо сейчас, в это мгновение, мы начинаем понимать логику истории, разбираться в текстах давних времён и, замечая закономерности, даже прогнозировать будущее.

Итак, активное знание - это, как замечает Пол, «знание, порождённое плодотворными идеями». Таким способом мы можем получать информацию в любой из научных сфер: весьма демократичная практика, которую способен освоить каждый. Единственное, что понадобится прежде, чем начать - это запастись привычкой докапываться до сути вещей и смирением с тем, что знание гораздо глубже, чем может показаться на первый взгляд.

Жизнь в постиндустриальную эпоху накладывает свои отпечатки на сознание человека. Понятие «информация» в наше время стало таким же ключевым, как вода и воздух. Чтобы осознать всю важность этого явления, нужно разобраться в толковании термина.

Что такое информация?

Многофункциональность термина породила множество его толкований. Так, в зависимости от сферы использования, информация - это:

Согласно Федеральному закону Российской Федерации «Об информации, информационных технологиях и защите информации» (2006 г.), это понятие толкуется как «сведения (сообщения) независимо от формы их представления».

Таким образом, информация - это данные, представленные в различных видах. Этот термин считается ключевым в работе журналиста.

Что такое актуальная информация?

Еще одной отличительной особенностью данного понятия являются его свойства. К атрибутам информации относят ее качество, количество, новизну, ценность, достоверность, сложность и способность компрессироваться. Каждый из этих показателей можно измерить. Также важное свойство понятия «информация» - это ее актуальность.

Не все данные будут соответствовать этому показателю. Истоки слова «актуальность» прослеживаются в латинском языке, где оно толковалось как «современный», «важный в теперешний момент», «злободневный». Особенность этого качества состоит в том, что оно может быть утрачено при появлении более свежих данных. Этот процесс происходит сразу и полностью либо постепенно и частями.

Актуальная информация - это данные, находящиеся в состоянии, которое соответствует действительности. Будучи устаревшими, они теряют свою ценность.

Поиск информации

Современность представляет собой безграничный океан данных, в котором ежедневно требуется находить то, что будет удовлетворять наши запросы. С целью структуризации процесса поиска информации даже была создана отдельная наука. Ее отцом считается американский учений Кельвин Мауэрс. Информационный поиск, согласно определению исследователя, - это процесс выявления в неопределенном количестве документов тех, которые смогут удовлетворить наши информационные потребности, то есть содержат необходимые данные.

Алгоритм действий включает в себя операции по сбору, обработке и предоставлению запрашиваемых сведений. Для эффективного поиска информации нужно следовать следующему плану:

- сформулировать запрос (сведения, которые мы хотим найти);

- найти вероятные источники необходимых данных;

- выбрать нужные материалы;

- ознакомиться с полученным массивом знаний и оценить проделанную работу.

Данный алгоритм способен облегчить образовательный процесс и подготовку к написанию научных статей. Он был создан путем осознания автором того, что информация - это безграничное пространство вокруг нас. И извлечение необходимых данных возможно только при условии систематизации своих усилий.

Сбор и хранение информации

В зависимости от поставленных целей данные и сведения можно подвергать различным операциям. Сбор и хранение - одни из них.

Работа с информацией возможна только после тщательного поиска. Этот процесс имеет название сбор данных, то есть накопление с целью обеспечения достаточного количества для дальнейшей обработки. Данный этап работы с информацией считается одним из самых важных, ведь от него зависят качество и актуальность данных, с которыми придется иметь дело в последующем.

Фазы сбора сведений:

- первичное восприятие;

- разработка классификации полученных данных;

- кодирование объектов;

- регистрация результатов.

Следующим этапом в работе с информацией является обеспечение ее сохранности для последующего пользования.

Хранение данных - это способ налаживания их обращения в пространстве и времени. Этот процесс зависит от носителя - диск, картина, фотография, книга и т.д. Срок хранения тоже дифференцируется: школьный дневник нужно хранить на протяжении учебного года, а билет в метро - только во время поездки.

Информация - это то, что существует только на определенном носителе. Поэтому процессы сбора и хранения можно считать ключевыми в работе с ней.

Способы передачи информации

Циркуляция данных - это необратимый процесс, с которым мы сталкиваемся повсеместно. Возможность передавать информацию от человека к человеку - залог эволюции всей цивилизации. Это явление представляет собой перемещение знаков и сведений в пространстве с целью организации доступа к ним других субъектов.

Средства информации - это ее носители, то есть все, что может служить для хранения данных.

Схема передачи сведений состоит из таких звеньев: источник, канал связи и получатель (реципиент). Использование с этой целью технических средств предусматривает предварительную кодировку сообщения в удобную для передатчика форму и последующую его расшифровку. Среди них можно выделить телеграф, телефон, телевизор, радио, Интернет.

Мощнейшим средством передачи данных во все времена считались медиа. Они действуют на огромных территориях и играют ключевую роль в формировании общественного мнения.

Защита информации

Хотя сведения об окружающем мире являются открытыми для ознакомления, некоторые из них имеют особый статус и закрыты для посторонних лиц. К ним относят тайны государственные, коммерческие и судовые, данные о новых изобретениях до публикации официального сообщения о них, а также персональную информацию о событиях жизни субъекта, позволяющие идентифицировать его личность.

- определение данных, считающихся конфиденциальными;

- ограничение доступа к ним путем установления специального порядка обращения и контроля над соблюдением этого порядка;

- учет получивших доступ к конфиденциальной информации;

- нанесение на материальные носители грифа «Коммерческая тайна».

Все это - необходимые меры безопасности. Придерживаться их - значит, предупредить огромное количество преступлений, махинаций и спасти жизни множества людей.

Как видим, исследование сути термина «информация» - это процесс, включающий в себя работу во многих сферах и заключающийся в оценке качеств и способов обработки сведений, отражающих факты окружающего мира.

Открытие бизнеса

Где можно и где нельзя работать после туберкулеза Где можно работать после

Форекс

Направления повышения эффективности использования собственного капитала На базе двигателя с плоским печатным якорем разработаны изделия для автомобильной промышленности

Банки